以春山之聲 Voice、春山之巔 Summit、春山文藝 Literati、春山學術 Academic 四個書系,反映時代與世界的變局與問題,同時虛構與非虛構並進,以出版品奠基國民性的文化構造。臉書:春山出版。

《真相製造》:時代金礦:祖克柏與臉書的使用者互動率

《真相製造》電子書連結 https://readmoo.com/book/210186312000101

五年、橫跨八國,一個臺灣記者來自前線的第一手採訪與關鍵實錄

★金鼎獎、卓越新聞獎、人權新聞獎、亞洲出版協會大獎、吳舜文新聞獎得主,近年來最受矚目的國際新聞記者

近年來網路與社群媒體的興盛,人們的連結、互動與訊息共享變得更容易,然而,這也使得民主國家面臨前所未見的考驗。極端主義以網路為工具點火,使穆斯林青年成為恐攻分子;境外勢力可以跨海介入另個國家的總統大選,使社會分裂;當網路行銷與政治利益結合,傳遞的是人民的聲音,還是產業的聲音;日漸極端化的立場,又如何在每一個國家樹立新的「柏林圍牆」?寄生於網路的「真相產業」,從政治、商業到社會心理層次,如何在全球演變,成為亟需理解的新課題。

記者劉致昕二○一六年以布魯塞爾為第一站,從訪問傷心卻不絕望的聖戰士媽媽開始,帶著我們深入真相製造在不同國家造成的致命效應,橫跨比利時、法國、印尼、德國、中國與臺灣,不僅有第一手的採訪,透過這些國家呈現真相產業不同面向的威脅,最珍貴的,是採訪到的每一個人物。劉致昕的報導當中沒有絕對善良的好人與邪惡的壞人,被這些處境所傷害吞噬的人們,起身對抗挽救頹勢的人們,在其中牟取套利空間的人們,這本書寫的是他們的故事。故事的基調是鋪展他們所在的社會結構,為何如此行動,以及提出時代趨勢往何處去的警示。

這個時代我們就置身其中,共同經歷、見證過一些事件,但總是很難說得清楚,在假新聞讓一切真假難辨的時候,我們正需要一本堅實的報導之作,在訊息的流沙中不致暈眩。

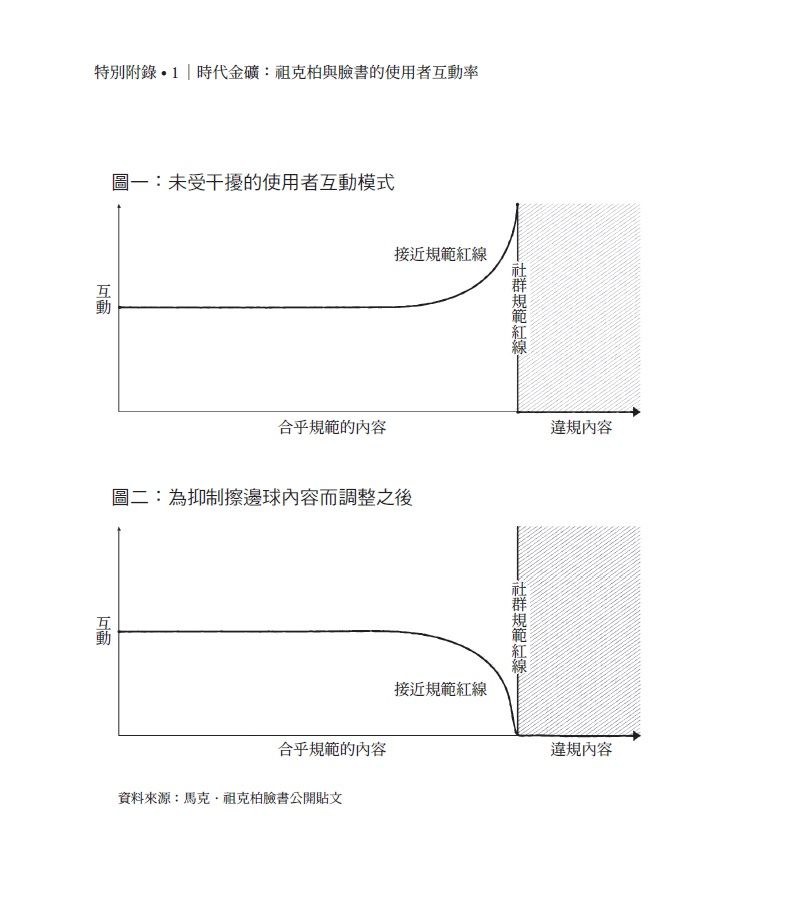

二○一八年美國期中選舉前,面對各界的壓力,臉書創辦人祖克柏發表了三千多字長文和兩張圖,想對外宣示臉書面對資訊操控和不實資訊,是有投入心力和改革決心的。他寫道,「我們的研究指出,不論我們把這條線畫在哪裡,愈靠近這條線的內容,人們與它互動的程度愈高。雖然使用者總是告訴我們他們討厭這類內容。」

祖克柏發表的研究結果,是長期以來人們就知道的。圖一說的是,愈爭議、愈接近臉書平臺社群守則紅線的內容(包括新聞、照片、影片、文字貼文等形式),主題可能包括仇恨言論、謾罵、爭議訊息、情色暗示等,使用者愈愛分享、按讚,而互動愈多的內容,在臉書的演算法中,更容易被推播、出現在每個人的動態牆上。

祖克柏以「根本的動機問題」來形容。他認為,解方不是那條線該畫在哪裡,因為不論怎麼畫,都會有擦邊球的爭議內容,關鍵是臉書是否能阻止這類內容在平臺上瘋傳?背後的真正問題有二,首先是臉書是否能快速偵測到有問題的內容,第二,當偵測到具有高互動性卻可能「有毒」的訊息,臉書的平臺機制,是否能一反常態地調低這則貼文的觸擊率?這兩點若是做不到,追求聲量的政客、追求點閱率的內容農場、追求廣告收入和績效的網路行銷人員,就會繼續製造這類內容,透過臉書演算機制讓訊息遠播、賺取流量。

圖二是祖克柏想要達到的目標,他稱臉書正在尋求可能的做法,利用人工智慧偵測到這些內容並調降它的曝光,這代表了臉書平臺必須進行連串修正,包括動態牆、推薦社團、推薦粉絲頁在內所有的推薦機制,讓問題內容得到的曝光成為圖二的曲線,從根本破壞人們製造問題內容的動機。

只是,祖克柏提到的利用人工智慧審查跟偵測內容,要做到快速辨認出不實與爭議資訊,機器學習必須能跟上各國議題更迭的速度。但臉書全球使用者眾,要人工智慧快速跟上從緬甸羅興亞人屠殺到香港反修例運動等最新新聞議題,幾乎是不可能的任務。再者,即使偵測到問題內容使其下架,但每則問題內容只要在用字、圖片上稍做變化,就能躲過自動偵測,重新出現在平臺上。

除了技術上的挑戰,同樣棘手的還有政治上的挑戰。在二○一八年期中選舉前的八月底,當時美國總統川普和部分共和黨政治人物,對臉書、Google等網路平臺提出抗議,稱矽谷菁英們打壓保守派聲音,各種資訊管控、政策都是要消滅川普和其支持者,人工智慧也會有偏誤。這樣的說法持續至今,不只造成政治壓力,也打中了祖克柏最在意的部分,他承受不起失去保守派使用者的風險,臉書若要持續做為最大的社交平臺、擁有最多廣告收入,就必須讓各種意識形態支持者都能信賴。於是在川普的指控後,臉書內部投入更大資源強調其演算法沒有偏見,並確保在刪除假帳號、偵測散布不實資訊的粉絲專頁時,兼具「公平性」。儘管所謂的公平性定義並不清楚,但祖克柏只能以此回應川普對「打壓保守陣營」的指控。

二○二○年美國總統大選,人們檢視臉書在二○一八年做出的承諾,祖克柏是否解決不實資訊這項他口中足以影響臉書長期營運的問題?臉書是否不惜冒著使用者與平臺互動降低的風險,真的調整了推薦機制,改變爭議訊息製造者的「根本的動機問題」?

一項針對二○二○年美國大選中臉書與使用者互動數的研究,給出悲觀的答案。這項美國紐約大學團隊進行的調查,分析了自二○二○年八月開始,在大選前後六個月內,來自二千九百七十三個新聞資訊來源透過臉書專頁發布的約八百六十萬則貼文。分析後發現,來自政治意識形態被歸類極右派的新聞類粉絲專頁(包括媒體、替代性媒體、政治資訊來源),仍是各政治光譜的粉絲頁中互動數最高的。若進一步比較極右派粉絲頁間的互動,含有不實資訊的極右派資訊來源得到的互動數,遠高於不含不實資訊的極右派粉絲頁,差距高達六五%。

二○二一年三月底,美國國會召開的聽證會上,祖克柏再次被問到了兩年前自己所提出的問題:「臉書上愈具爭議的內容是否仍得到更高的互動」。他躲避了議員的直接提問,用一慣的說法回覆他兩年前宣稱要解決的問題,說他們正在持續、系統性地投入資源,打擊人們不樂於見到的不實資訊。

對許多人來說,祖克柏的表現雖然令人失望,但並不意外。《麻省理工科技評論》在二○二一年三月的一篇調查報導中,透過專訪臉書核心人工智慧團隊,爬梳他們如何透過廣告配對技術獲利,同樣的邏輯也延伸至動態牆上的內容呈現,讓使用者對自己喜愛的內容上癮,對臉書上癮。而臉書的營運也因此對這種勾住使用者、用相對應內容換取互動的盈利模式成癮。「當你的生意建立在最大化的互動,你對事實大概沒什麼興趣,也不會對有害內容、分裂、陰謀論等言論有什麼興趣研究,事實上,那些可能是你(生意)的朋友。」與臉書合作多項研究計畫的加州大學柏克萊分校教授法里德(Hany Farid)受訪時說。他的說法並非空談。祖克柏在二○一八年九月發表的內容,其實,從二○一六年就不斷出現在臉書內部的研究中,多項研究計畫的結果都指出,推薦機制必須改善。以使用者成長、提高使用者互動為最高目標的臉書,可能因此成為不實資訊、極端化內容的溫床,對社會的極端化造成直接影響。

例如,二○一六年,臉書內部的研究員莫妮卡.李(Monica Lee),發現臉書不只成為大量極端組織的棲地,臉書向使用者推薦的「你感興趣的社團」、「探索」等機制,也協助這些極端組織被更多使用者看見、進而茁壯。二○一七年,臉書首席產品長考克斯(Chris Cox)的研究也發現,追求使用者互動最大化造成使用者在社會與政治議題上極端對立,但是,若以降低極化為優先目標而調整平臺的運作,可能造成使用者互動下降。自二○○五年就擔任首席產品長的考克斯在二○一八年中提出了幾個可能的修正,例如調整推薦機制演算法,讓推薦內容更多元、讓使用者加入更多元的團體等等,但研究團隊也認知到這些修正可能無助於臉書平臺的「成長」。最終,透過二○二一年三月《麻省理工科技評論》發表的追蹤報導證實,當時大部分提案並沒有得到任何進一步的發展與資源,研究團隊也解散了。

一位匿名受訪的前任臉書人工智慧研究員,向《麻省理工科技評論》表示,二○一八年加入臉書的他,持續進行考克斯未完成的研究,進一步確認追求使用者互動最大化的演算法機制,會增加政治極化。這名匿名受訪者表示,臉書數據得以清楚追蹤使用者對各議題立場的異同程度、使用者喜歡與哪些內容互動、造成他們的立場最終有什麼樣的變化,他們見證了臉書的演算法機制,如何一次又一次餵養使用者更加極端化的內容,「使用者在這種機制下,使用時間愈長,他們就變得更加極化,而這些變化在研究中都是可量測的。」他們的研究甚至發現,與憂鬱內容互動的使用者,可能輕易就進入迴圈,不斷消費負面內容,進而有傷害心理健康的風險。《麻省理工科技評論》的這篇文章更指出,臉書內部對員工的績效衡量、薪資分配,與他們的專案是否成功直接相關,而當「成功」代表高互動、新增使用數時,員工們自然就會放下領導層所不鼓勵的方向,以「由上而下」的指令為優先。

四年來面對各方的指責跟質疑,祖克柏除了在二○一八年公開發表他的改革想法,也透過公開投書表態,歡迎立法者在對科技有足夠理解下,對平臺業者的資訊管控提出「最佳方案」(best practice),臉書將樂於追隨,只是祖克柏認為,一旦平臺業者做到立法者對於最佳方案的規範,將不必再為平臺上的內容負責。

祖克柏的說法,再次把球丟回立法者的身上。這種做法,對同樣曾靠著臉書平臺做生意的前劍橋分析業務總監布蘭特妮.凱瑟(Brittany Kaiser)來說,對改變現況無益。二○一九年末,她在我們的越洋專訪中這麼說:「臉書仍是對民主最大的威脅,」凱瑟說,「你可以試著立出最好的法律,但如果你沒有足夠先進的科技去執行它們(偵測不實資訊、資訊操作等),問題不會解決。需要改變的是臉書做生意的方式,而不只是法律。」她認為,臉書必須公開他們收集、使用和販賣數據的方式,同時必須禁止對使用者投放含有不實資訊的廣告。她認為,臉書提出的政治廣告透明化做法,無助於停止社群平臺對民主造成的傷害,已占據全球廣告重要市場的臉書 ,必須投入足夠的資源,擔起責任,用人工智慧及足夠人力,確保自己不會對社會造成傷害。「是時候停下來思考,在沒有足夠進步的技術跟良善規範前,臉書必須停下政治廣告,這是不是比人們被騙、選民害怕投票、不同族群開始憎恨彼此要好上一些?」她強調,禁止政治廣告並非長久之計,長遠來說,商業模式中該補的破洞,還是必須有人負責,「我們總不能讓政治透過不透明的數據與社群平臺系統來操控我們吧?」

被視為爭議性人物的凱瑟,在當時以吹哨者之姿,揭露劍橋分析如何不正義地使用臉書使用者資料,做為政治行銷的工具,並在二○一六年美國總統大選中,透過精準投放等手段影響人們的認知。但同時,也有人認為她的說法過於誇大,劍橋分析並不是大數據的魔法師,對於選民投票意向的影響有多大,尚需進一步驗證。但與凱瑟的專訪,的確讓我們看見社群媒體時代,以追求互動為終極目標、靠著廣告獲利的社群平臺,如何成為追求政治聲量的政治人物愛用的服務商,如何成為他們野心的寄託。

凱瑟回憶二○一六年的選舉現場,「那些科技公司都在場,Facebook、Twitter、Google,每天都跟選戰團隊展示怎麼使用他們的工具,他們稱自己為『進駐者(embeds)』,雖然付他們薪資的是Facebook、Twitter、Google,但他們每天都在幫川普陣營工作。」在二○一六年的川普選戰中,Twitter以「免費勞工」之名,在競選團隊辦公室內提供服務,販賣新的廣告工具如對話式廣告等,確保川普的Twitter貼文熱度超過希拉蕊。臉書則稱自己是「客戶服務+」,向競選辦公室提供新的服務,包括聚集、創造和訂製受眾、投放只有特定受眾才能在動態消息上看到的隱藏廣告(dark ads)。Google則取名為叫作「顧問能量」,每天向川普團隊出售獨家廣告空間,如YouTube的首頁廣告。投票日當天,大量關鍵字搜尋賣給川普團隊,有效控制第一印象,用來吸引大批支持者,例如搜尋川普、伊拉克、戰爭,第一個搜尋結果會是「希拉蕊投票支持伊拉克戰爭,但川普反對」,如果使用者輸入「希拉蕊」、「貿易」兩個詞,第一個搜尋結果是「lying-crookedhillary.com」,意為說謊的希拉蕊。

「這種服務當然只有大戶才會有,服務名稱叫『白手套』,」凱瑟說,只有砸下一億美元數位廣告預算的川普陣營,才能享有此服務。以廣告為盈利主要方式的網路平臺,它們收集的數據、提供的廣告投放工具和包括臉書粉絲頁、推特帳號等門檻極低的內容發表工具,像幾大支柱,搭起了一整個生態系,臉書、Google、推特、Youtube等就是生態系中最大的幾個商人,其他還有大小不一的商人,寄生生產鏈的上下游,有人生產內容,有人為了創造高互動而製造爭議和不實資訊;有人負責投放,有人負責分析平臺收集的數據並找到投放目標;還有人透過收集而來的數據,判斷討論的熱度、聲量大小,找到意見領袖,接著以顧問之姿,讓有心在平臺上掌握聲量的金主,知道錢怎麼花、如何搭著社群平臺去搶奪使用者的注意力。祖克柏捨不得斬斷的使用者互動,就是這群商人們分食的金礦來源,他們寄生在臉書、Google廣告、YouTube、推特等平臺上,跟著平臺政策的變更,重新調整賺錢的方式,他們非常有把握地告訴我,只要平臺業者以廣告為主的商業模式不變,他們的生意將源遠流長。

喜欢我的文章吗?

别忘了给点支持与赞赏,让我知道创作的路上有你陪伴。

发布评论…